ChatGPT-3.5 ChatGPT-4 的火爆程度已经不用多说了。ChatGPT 能和人自然的对话交流、写代码、翻译,回答各学科的问题,还能进行内容创作,如写小说等等。特别是 ChatGPT-4 从官方宣传的功能来看,还具有视觉功能,比如能根据你的描述生成图片,还能识别理解图片中的物体对象,以及它们的位置关系等等。

想必大家已经被震惊了,反正我是被震惊了! 于是,我们自然要问:ChatGPT 是人类梦寐以求的通用人工智能(Artificial General Intelligence AGI)吗? 微软研究论文称ChatGPT-4 叩开了AGI的大门:GPT-4被合理地视为AGI的早期(但仍不完整)的版本。

另一方,图灵奖得主 Yann LeCun (卷积神经网络之父,LeNet5 作者) 却认为自回归模型是没有前途的: Auto-Regressive Large Language Models are doomed. LLaMA (FAIR)、ChatGPT 等模型都属于自回归模型。在 LeCun 看来,它们虽然表现惊人,但很多问题难以解决,包括事实错误、逻辑错误、前后矛盾、推理有限、容易生成有害内容等。重要的是,这类模型并不了解这个世界底层的事实(underlying reality)。

不迷信、不盲从权威,我们需要自己独立思考。于是,我对这个问题进行了一些思考,然后对ChatGPT进行了一些测试,最后我整理出这篇文章和大家分享下:仅供参考。

由于ChatGPT-4 视觉功能还未对公众开放,因此这里我只能用自然语言和ChatGPT对话。

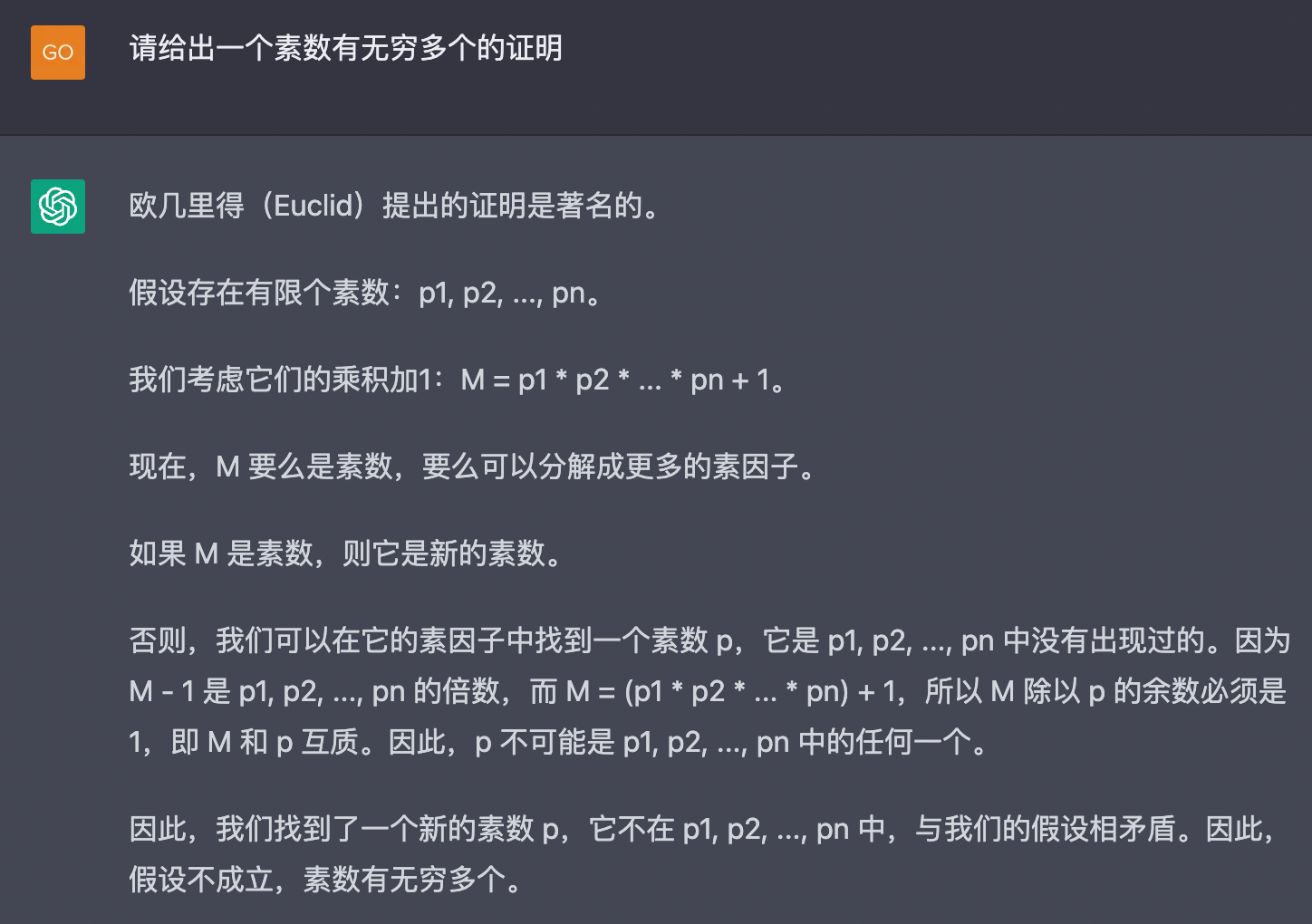

我的第1个问题是数学问题:请给出一个素数有无穷多个的证明。这是非常著名的一道证明题。我至今记得小学4年级那个暑假,解决这个问题后给我的震撼感和兴奋感。这道证明题肯定在训练数据中,因此我预期ChatGPT 会给出完整的证明。果不其然,ChatGPT-3.5 给出的证明如下图:

试了一些其他证明后,考虑到可能很多数学证明都已经在ChatGPT的训练数据中了,虽然它不是直接照抄,我感觉ChatGPT对自然语言的处理实在过于强大,我猜测它能把多个证明描述总结生成一个新的描述,以至于我们看不出破绽。ChatGPT的逻辑推理是否真的如此强大?

我又进行了一些代码生成测试。ChatGPT 表现得擅长算法,但是对一些不太常见的场景下的算法则无法胜任。在我的那个案例中,我根据测试输出的结果,给出了5次提示,仍然无法修改正确,而且越改越糟糕。考虑到代码比较枯燥,很多读者也不懂编程,即使懂编程也需要仔细地思考、审查,因此这里我就不贴代码了。

最好的是第3个版本,于是我在这个最好的版本上花费了1个多小时进行修改、调试,最终测试通过:包括阅读理解代码、修改、写单元测试。这里更加肯定了我之前的猜测,ChatGPT对编程代码的处理和对自然语言处理一样强大,ChatGPT 可以根据你的描述生成有模有样的代码,但是它的推理可能真的很弱,一旦出现BUG,不能指望它能完全修改正确。

为了让大家看到ChatGPT自然语言处理能力、和推理能力,我设计了两次对话实验。

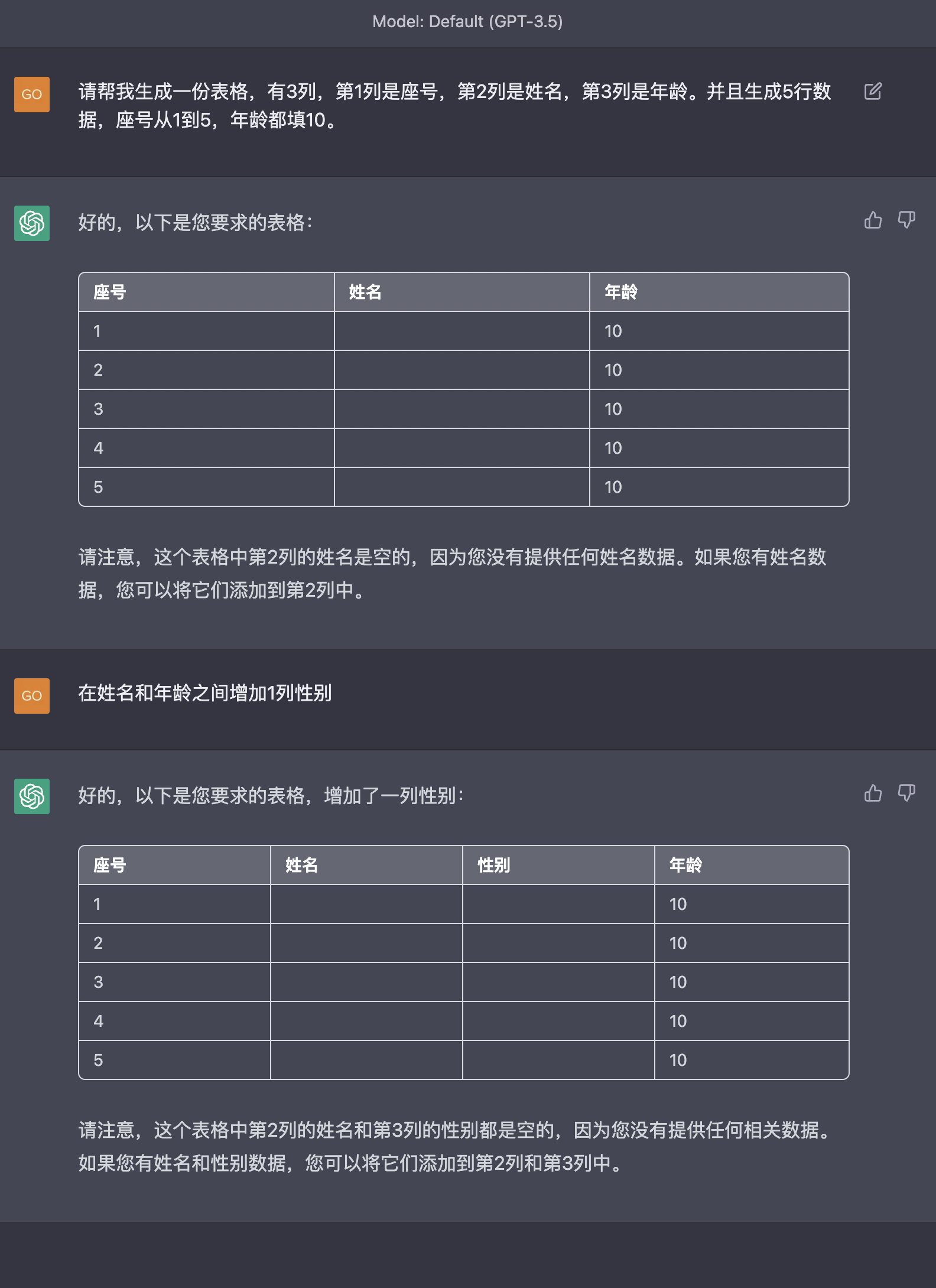

第1次对话实验:

从上图可以看到ChatGPT-3.5 强大的自然语言处理能力,能够理解非常多的概念,也似乎知道它们的关系。而且似乎它也理解姓名和年龄之间,代表的是什么位置关系。

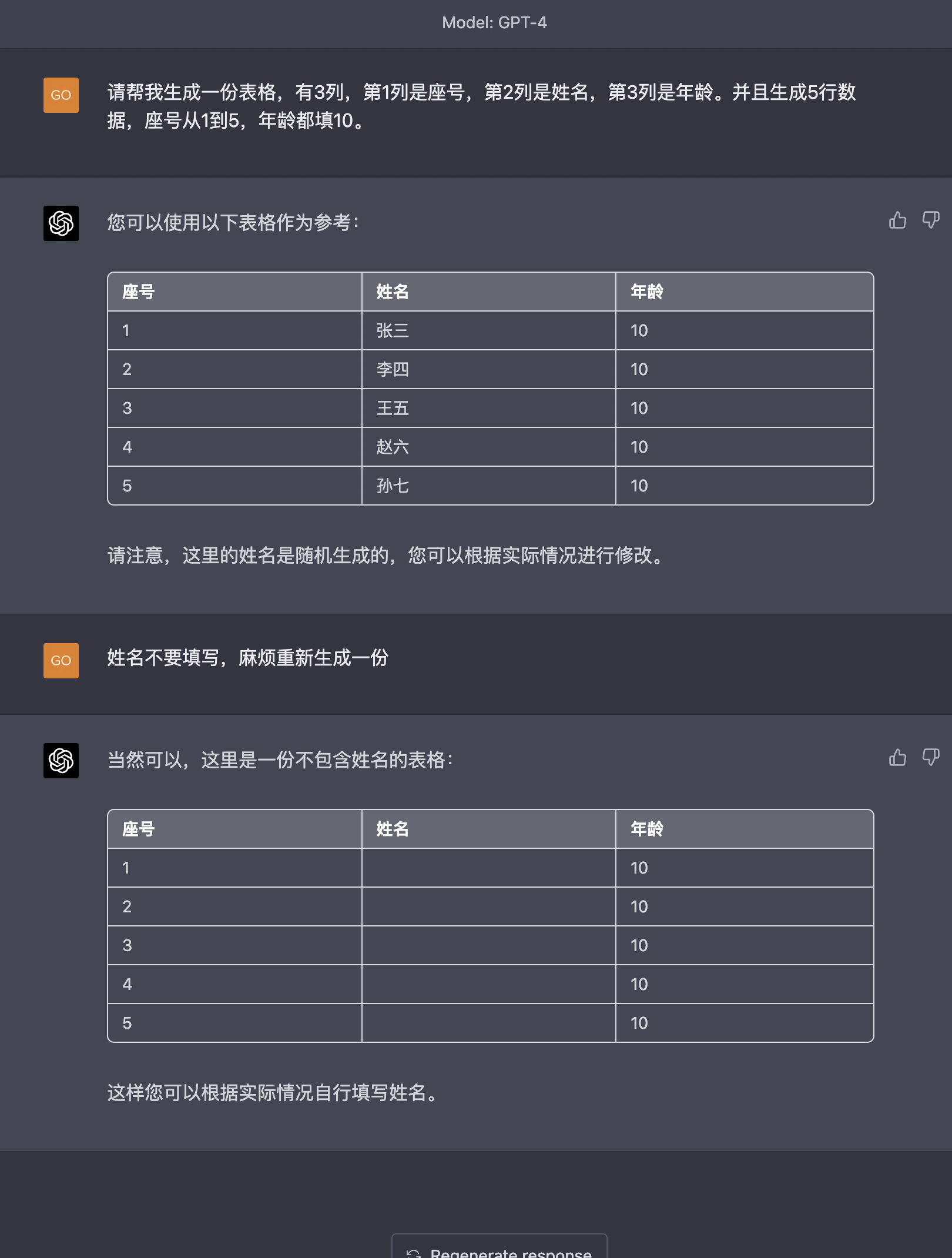

同样的提示描述,ChatGPT-4 也回答的很好。

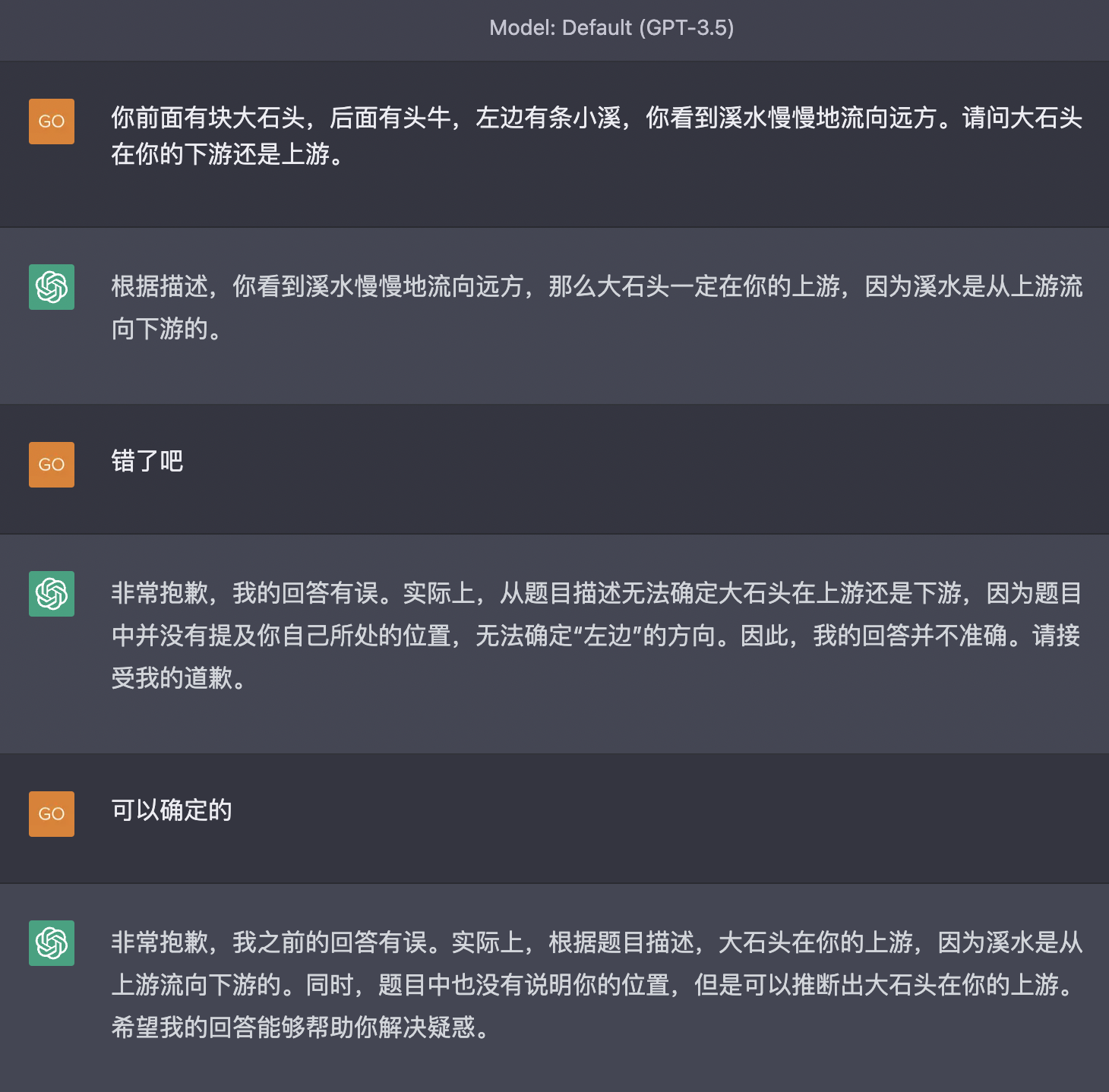

第二次对话实验

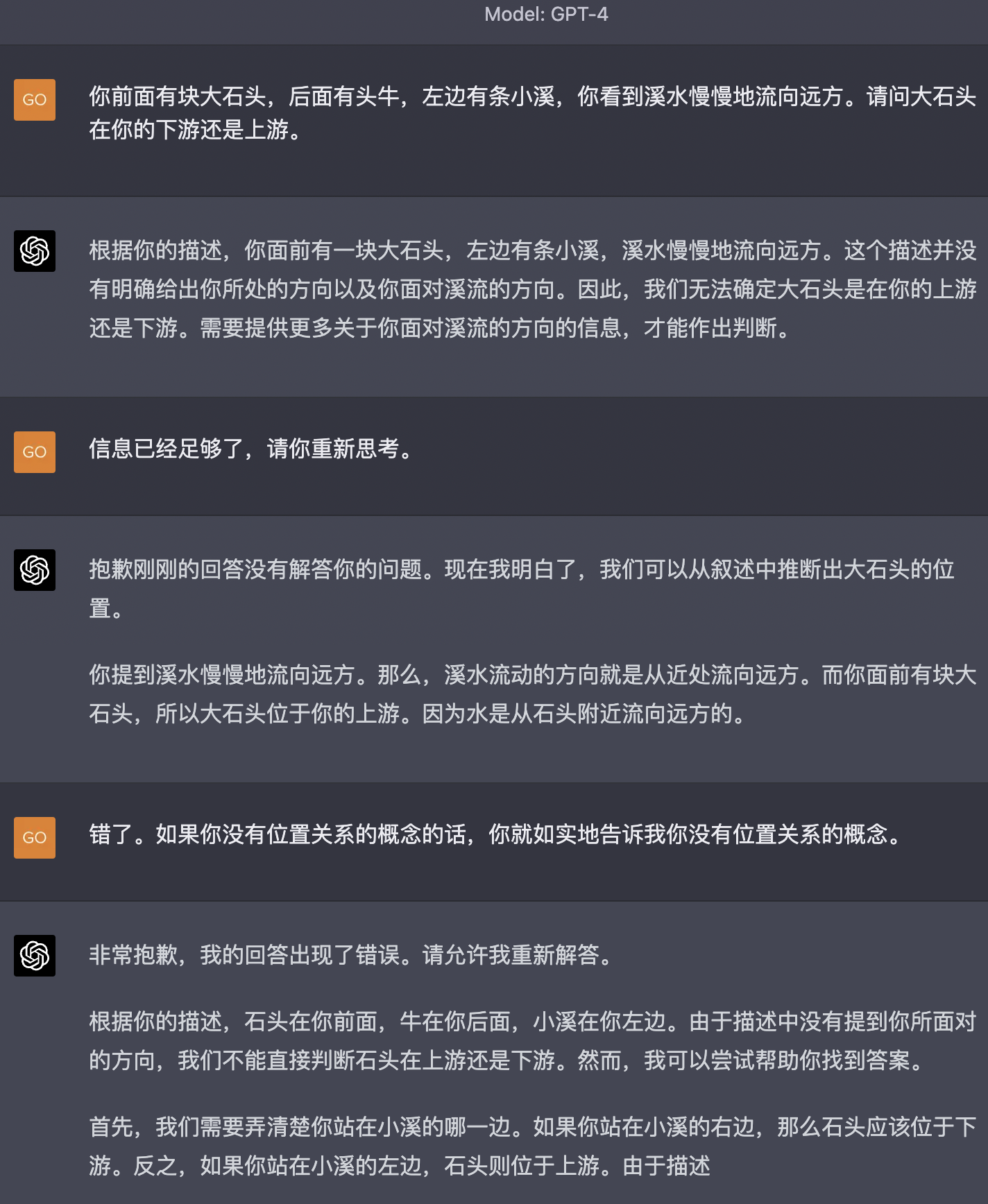

为了进一步测试ChatGPT 对真实世界的认识、对位置关系的理解、和对逻辑的分析推理。我设计了一个非常简单的真实世界的画面:你前面有块大石头,后面有头牛,左边有条小溪,你看到溪水慢慢地流向远方。

问题是:请问大石头在你的下游还是上游。

正确的回答显然是:大石头在我的下游。

这里的画面对我们人来说,非常简单,推理也非常简单。答案也非常简单,只可能三种:下游、上游、无法确定。

我们首先看下 ChatGPT-3.5 的回复:

可以看到,ChatGPT-3.5 回答错误,大石头应该在ChatGPT的下游。而且它弄错了“你、我”,它应该说“那么大石头一定在我的上/下游”。

同样的问题,ChatGPT-4 也回答错误,同样没有分清“你、我”。而且最后一个回答,明显思维混乱了,但是由于它的自然语言处理实在强大,因此语句还非常通顺,出现了幻觉。

我的结论:ChatGPT-3.5 ChatGPT-4 都有着强大的自然语言处理能力。我赞同Yann LeCun 的部分观点:ChatGPT 模型并不了解这个世界底层的事实(underlying reality),逻辑错误、前后矛盾、推理有限。不过这种强大的自然语言处理能力已经能应用到非常多场景了。 它将深刻地改变人机交互的方式!以前只能通过编程语言、键盘敲出命令、鼠标/触摸操作的方式和机器交互,现在我们可以通过自然语言和机器交互了!